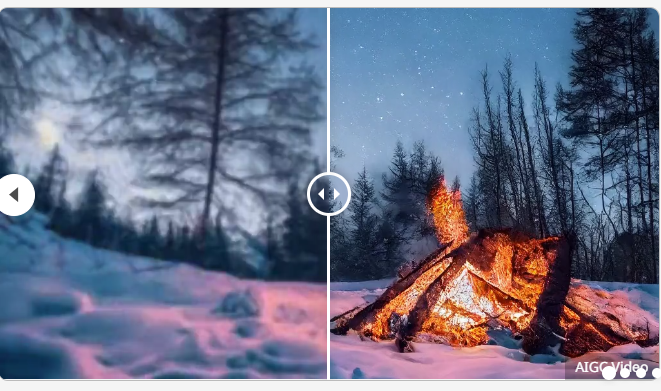

視頻生成確實是向各個方向滾動的。以下是演示和居間:

簡介:

Upscale-A-Video的文本引導潛在擴散框架用於視頻升級。該框架通過兩個關鍵機制確保時間一致性:在本地,將時間層集成到U-Net和VAE-Decoder中,維護短序列的一致性;

在全球範圍內,引入了流引導的循環勢傳播模塊,通過在整個序列中傳播和合併潛在勢來增強整體視頻穩定性。

得益於擴散範式,該模型還通過允許文本提示來指導紋理創建並可調節噪音水平來平衡恢復和生成,實現了保真度和質量之間的權衡。

方法:

高級視頻處理具有本地和全球政策的長視頻,以保持時間一致性。它將視頻分為片段,並使用具有時間層的U-Net對其進行處理,以確保片段內的一致性。在用戶指定的全局粒度擴散步驟中,使用循環潛伏傳播模塊來增強片段到片段的一致性。最後,經過微調的VAE-Decoder減少了殘餘閃爍偽影,以實現低級別一致性。

結果:

大量實驗表明,Upscale-A-Video在合成和現實世界基準中優於現有方法,並在人工智慧生成的視頻中展示了令人印象深刻的視覺真實感和時間一致性。

項目地址: https://shangchenzhou.com/projects/upscale-a-video/

視頻地址: