Twelve Labs推出了Pegasus-1,這是一種先進的視頻語言基礎模型,具有約800億個參數。

它可以處理從10秒到數小時的視頻內容,並理解、識別和解析視頻,以生成更全面、準確的文本描述。

它可以全面了解視頻中的人、物、場景,以及背景音樂、對話等。

主要功能:

1.多模式理解:

Pegasus-1不僅處理視頻中的視覺信息,還理解音頻和語音信息。這意味著它可以更全面地了解視頻內容,包括視頻中出現的人、物體和場景,以及背景音樂、對話等。

2.高效的長視頻處理:

該模型優化了管理和處理不同長度視頻(從短至10秒到數小時)的能力。

3.視頻文本生成:

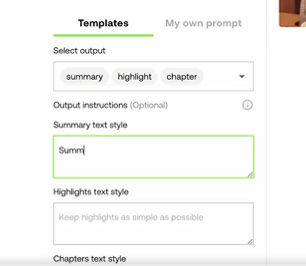

通過單個API調用,開發人員可以提示Pegasus-1模型從其視頻數據生成特定的文本輸出。這包括但不限於視頻摘要、關鍵點提取、自動生成標籤和標題等。

4.高級績效指標:

在MSR-VTT數據集和視頻描述數據集上,Pegasus-1相對於可用的最先進模型表現出61%和47%的相對改進。

5. API訪問:

Pegasus-1提供了一組靈活的視頻到文本API,可用於各種下游任務。

詳情: https://app.twelvelabs.io/blog/introducing-pegasus-1

工作原理:

與許多將視頻理解視為圖像或語音理解問題的方法不同,Twelve Labs採用「視頻優先」策略。

該策略有四個核心原則:高效的長格式視頻處理、多模式理解、視頻原生嵌入以及視頻和語言嵌入之間的深度對齊。

該模型由三個主要組件組成:視頻編碼器、視頻語言對齊模型和語言解碼器。

1.視頻編碼器:負責從視頻中提取視覺、音頻和語音信息並生成視頻嵌入。它評估視頻幀及其時間關係,以在處理音頻信號和語音信息時獲得相關的視覺信息。

2.視頻語言對齊模型:這一步是連接視頻嵌入和語言模型領域的關鍵。它確保語言模型以與理解文本標記類似的方式解釋視頻嵌入。

3.語言解碼器:解碼器利用其廣泛的知識庫,根據輸入用戶提示解釋對齊的嵌入,並將此信息解碼為連貫、易於閱讀的文本。

這三個組件一起訓練,使模型能夠更準確地理解和生成與視頻內容相關的文本。

數據集:

Twelve Labs收集了超過3億個經過精心策劃的多樣化視頻文本對。這使其成為最大的視頻語言基礎模型培訓視頻文本庫之一。

初始訓練子集:該技術報告基於3500萬個視頻-文本對和超過10億個圖像-文本對的初始訓練運行。該子集約占總數據集的10%。

該數據集不僅規模龐大,而且質量高且多樣化,有助於Pegasus-1在多個評估指標上實現高級性能。

MSR-VTT數據集居間: https://microsoft.com/en-us/research/wp-content/uploads/2016/06/cvpr16.msr-vtt.tmei_-1.pdf

ideo-ChatGPT視頻描述數據集: https://arxiv.org/pdf/2306.05424

原文: https://twitter.com/i/status/1718456086150435074